AI Proxy Self-hosted

AI Proxy Self-hosted umożliwia uruchomienie komponentu AI w infrastrukturze klienta (on-premise, private cloud, Azure). Zapewnia pełną kontrolę nad danymi i środowiskiem wykonawczym.

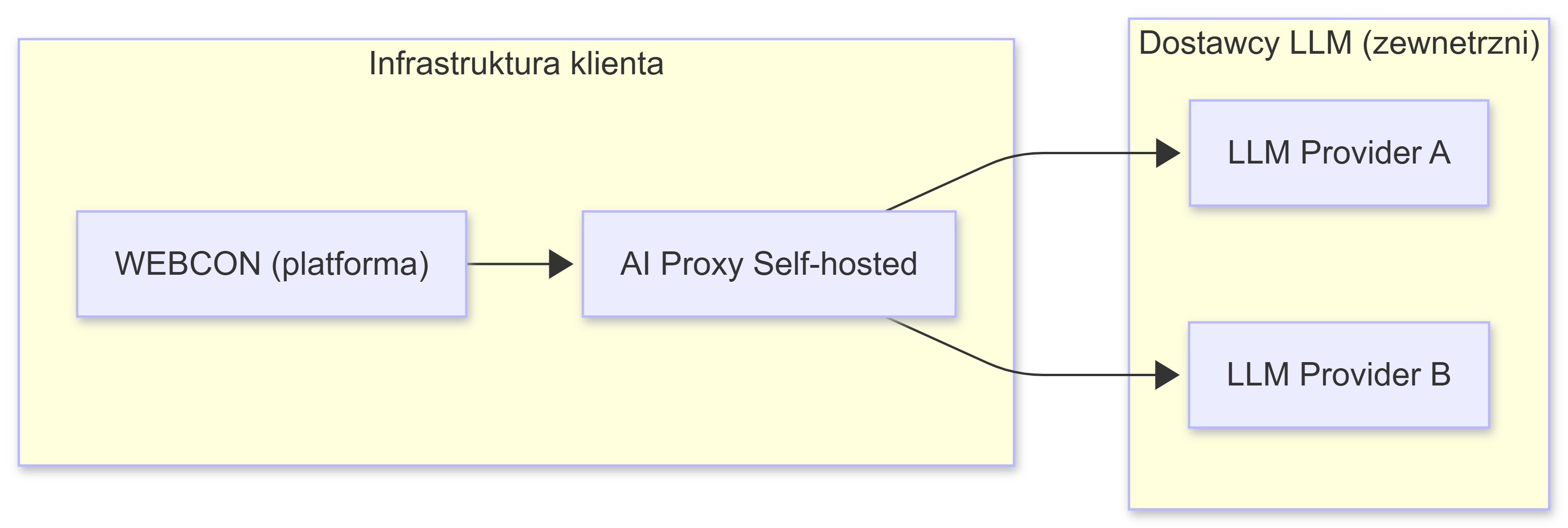

Architektura

AI Proxy działa jako warstwa pośrednicząca między WEBCON a dostawcami AI:

- WEBCON wysyła żądanie do AI Proxy

- AI Proxy:

- Waliduje żądanie

- Wybiera dostawcę/model zgodnie z konfiguracją

- Uwierzytelnia się przy użyciu kluczy API

- Przekazuje żądanie do dostawcy AI

- Odpowiedź wraca przez AI Proxy do WEBCON

Przypadki użycia

Wymagania compliance i bezpieczeństwa:

- Branże regulowane (finanse, healthcare, sektor publiczny)

- RODO, ISO 27001 i inne standardy

- Wewnętrzne polityki bezpieczeństwa danych

Środowiska deweloperskie:

- Lokalne testowanie bez kosztów chmury

- Rozwój i prototypowanie

- Integracja CI/CD

Produkcja on-premise:

- Pełna kontrola nad infrastrukturą

- Dane nie opuszczają infrastruktury klienta

- Możliwość audytu i monitorowania

Multi-vendor:

- Elastyczność w wyborze dostawców AI

- Strategie failover między dostawcami

- Optymalizacja kosztów

Technologie

- .NET 8 - runtime aplikacji

- Docker - konteneryzacja

- JSON - konfiguracja

- HTTPS/TLS - bezpieczna komunikacja

Obsługiwani dostawcy

- Google Vertex AI (Gemini)

- Azure AI Foundry

- OpenAI

Komponenty

- Obraz Docker:

webconbps/aiproxy:1.0.0.235 - Porty: 8080 (HTTP), 8081 (HTTPS)

- Pliki konfiguracyjne:

aiconfiguration.json- definicje połączeń i modeli- Certyfikat SSL/TLS (PEM lub PFX)

Następne kroki

- Getting Started - wybierz dostawcę AI i skonfiguruj dostęp

- Docker Configuration - uruchom kontener Docker

- AI Configuration - skonfiguruj modele i strategie